QQ群:446790204

QQ群:4467902042024年3月13日,欧洲议会以 523 票赞成、46 票反对和 49 票弃权的表决结果正式通过《人工智能法案》(Artificial Intelligence Act)。下一步,《人工智能法案》还需经欧盟理事会批准以成为一项正式的法律,并将在官方公报公布20天后生效。

《人工智能法案》适用范围广泛,包括:

位于欧盟境内的,人工智能系统的开发商(deployer)、提供商(provider);

位于欧盟境外的,将人工智能系统投放到欧盟市场或在欧盟投入使用的人工智能系统提供商;

位于欧盟境外的,相关人工智能系统产生的输出成果在欧盟内使用的人工智能系统开发商、提供商;

人工智能系统的进口商和分销商;

将人工智能系统与其产品一起,以自己的名义或商标投放市场或投入使用的产品制造商;

适用的提供商的授权代表;

欧盟境内的受影响人员。

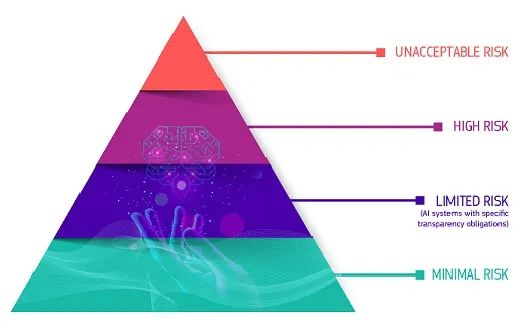

《人工智能法案》对人工智能系统的开发、投放及使用制定了统一的法律框架,侧重于人工智能系统的具体利用和相关风险,包括透明度相关的规则及某些禁令。同时,《人工智能法案》基于不同人工智能系统所对应的风险对其进行分级治理。

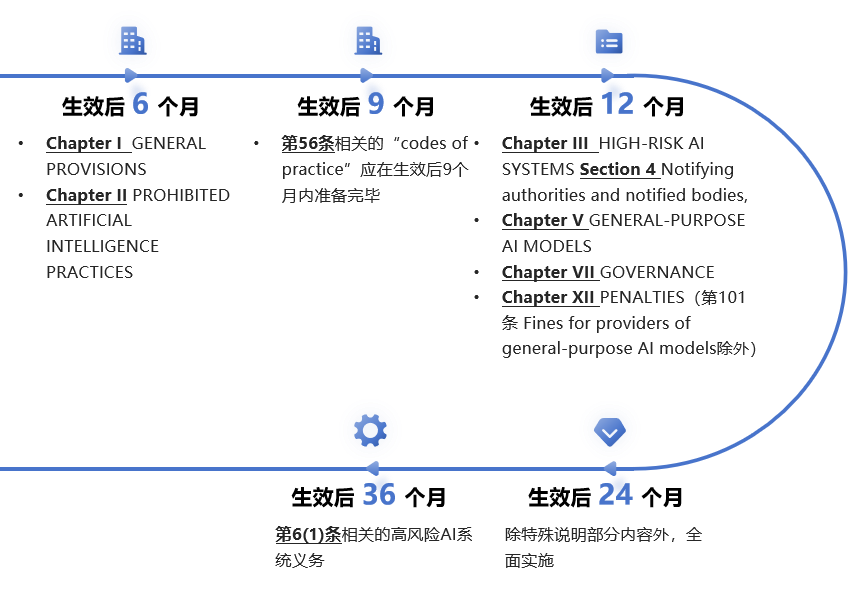

人工智能系统风险等级示意图 图片来源:欧洲议会 根据《人工智能法案》第5条,不可接受风险的人工智能系统将被禁止在欧盟投放市场、投入服务或使用。此类系统主要是对人的安全、生计和权利构成明显威胁的人工智能系统,比如利用个人或特定群体的弱点并可能损害相关群体利益的人工智能系统、基于敏感属性或特征的生物识别分类系统、用于预测刑事违法的系统、在工作场所和教育中推断情绪的系统、为建立或扩大面部识别数据库而从互联网或闭路电视监控录像中无差别收集面部图像的系统等。 《人工智能法案》通过附件界定了生物识别、基础建设、教育培训、雇佣管理等8个领域项下可能对健康、安全、基本权利、环境、民主和法治存在重大潜在危害的高风险人工智能系统。高风险人工智能系统将被重点监管。根据《人工智能法案》第三章,其开发商、提供商等义务主体需履行系列义务,包括建立充分的风险管理体系,使用高质量训练、验证和测试的数据集,准备反映人工智能系统的所有必要信息和目的及合规性的技术文件,及其他记录保存、透明度及信息提供、人类监督、准确度、稳健性和网络安全等方面的义务。 此外,《人工智能法案》还对通用人工智能系统(general-purpose AI models,GPAI)的透明度要求及具有系统性风险的GPAI的额外评估、报告等义务要求进行了明确。 根据《人工智能法案》第99条,违反该法案的公司最高可能面临3500万欧元或全球年营业收入7%数额的罚款。同时,相关监管机构可能采取相应纠正措施(corrective measures),禁止、限制、撤回或召回不符合法案要求的人工智能系统。 《人工智能法案》的实施和执行将分阶段进行,主要的实施日期节点如下所示。